5/7

時点_ポイント最大12倍

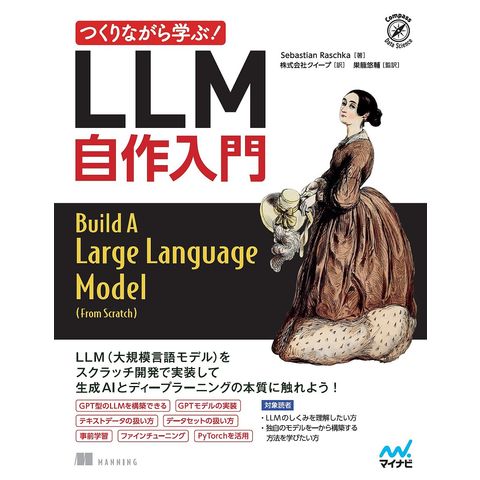

つくりながら学ぶ!LLM自作入門/SebastianRaschka/クイープ/巣籠悠輔

販売価格

3,982

円 (税込)

送料無料

- 出荷目安:

- 1~3日で発送予定

たまるdポイント(通常) 36

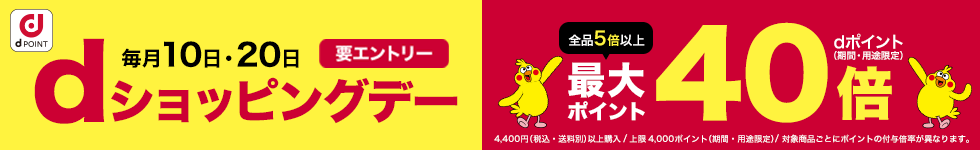

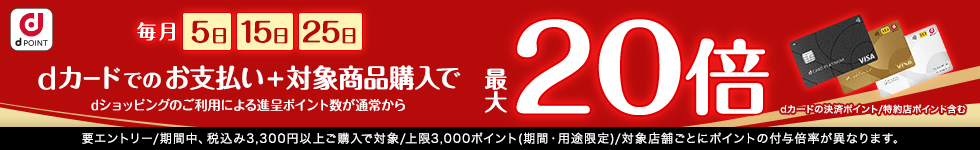

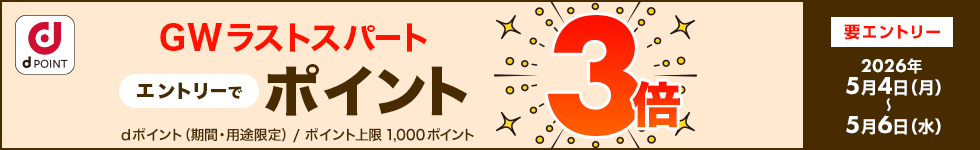

+キャンペーンポイント(期間・用途限定) 最大11倍

※たまるdポイントはポイント支払を除く商品代金(税抜)の1%です。

※表示倍率は各キャンペーンの適用条件を全て満たした場合の最大倍率です。

各キャンペーンの適用状況によっては、ポイントの進呈数・付与倍率が最大倍率より少なくなる場合がございます。

dカードでお支払ならポイント3倍

各キャンペーンの適用状況によっては、ポイントの進呈数・付与倍率が最大倍率より少なくなる場合がございます。

- 商品情報

- レビュー

SebastianRaschkaクイープ巣籠悠輔

マイナビ出版

Compass Data Science

ISBN:4839987807/9784839987800

発売日:2025年02月

【内容紹介】

本書は、GPT型のLLM (大規模言語モデル) を一から理解して構築するために書かれました。

テキストデータの扱い方とAttentionメカニズムのコーディングの基礎を理解した後、完全なGPTモデルの実装に取り組みます。

本書の特徴は、LLMの構築プロセス全体を包括的にカバーしていることです。これには、モデルアーキテクチャを実装するためのデータセットの扱い方から、ラベルなしデータでの事前学習、そして特定のタスク向けのファインチューニングまでが含まれています。

本書を最後まで読めばLLMの仕組みがしっかりと理解でき、独自のモデルを構築するためのスキルを身につけることができるでしょう。作成するモデルは大規模な基礎モデルに比べれば規模は小さいものの、基になっている概念は同じです。最先端のLLMの構築に使われている中核的なメカニズムやテクニックを理解するための強力なツールとなるでしょう。

「対象読者」

・LLMの仕組みを理解し、独自のモデルを一から構築する方法を学びたいと考えている機械学習の愛好家、エンジニア、学生

・本書はPyTorchを活用しており、事前にPythonプログラミングを理解している必要があります。

・機械学習、ディープラーニング、人工知能(AI)の知識があれば役立ちますが、幅広い知識や経験は必要ありません。

・高校レベルの数学、ベクトルや行列の知識は本書を理解する助けとなりますが、高度な数学の知識は不要です。

「目次」

1章 大規模言語モデルを理解する

2章 テキストデータの準備

3章 Attentionメカニズムのコーディング

4章 テキストを生成するためのGPTモデルを一から実装する

5章 ラベルなしデータでの事前学習

6章 分類のためのファインチューニング

7章 指示に従うためのファインチューニング

付録A PyTorch 入門

付録B 参考資料

付録C 練習問題の解答

付録D 訓練ループに高度なテクニックを追加する

付録E LoRAによるパラメータ効率のよいファインチューニング

“Build a Large Language Model (from Scratch)”(Manning Publishing 刊)の日本語版

マイナビ出版

Compass Data Science

ISBN:4839987807/9784839987800

発売日:2025年02月

【内容紹介】

本書は、GPT型のLLM (大規模言語モデル) を一から理解して構築するために書かれました。

テキストデータの扱い方とAttentionメカニズムのコーディングの基礎を理解した後、完全なGPTモデルの実装に取り組みます。

本書の特徴は、LLMの構築プロセス全体を包括的にカバーしていることです。これには、モデルアーキテクチャを実装するためのデータセットの扱い方から、ラベルなしデータでの事前学習、そして特定のタスク向けのファインチューニングまでが含まれています。

本書を最後まで読めばLLMの仕組みがしっかりと理解でき、独自のモデルを構築するためのスキルを身につけることができるでしょう。作成するモデルは大規模な基礎モデルに比べれば規模は小さいものの、基になっている概念は同じです。最先端のLLMの構築に使われている中核的なメカニズムやテクニックを理解するための強力なツールとなるでしょう。

「対象読者」

・LLMの仕組みを理解し、独自のモデルを一から構築する方法を学びたいと考えている機械学習の愛好家、エンジニア、学生

・本書はPyTorchを活用しており、事前にPythonプログラミングを理解している必要があります。

・機械学習、ディープラーニング、人工知能(AI)の知識があれば役立ちますが、幅広い知識や経験は必要ありません。

・高校レベルの数学、ベクトルや行列の知識は本書を理解する助けとなりますが、高度な数学の知識は不要です。

「目次」

1章 大規模言語モデルを理解する

2章 テキストデータの準備

3章 Attentionメカニズムのコーディング

4章 テキストを生成するためのGPTモデルを一から実装する

5章 ラベルなしデータでの事前学習

6章 分類のためのファインチューニング

7章 指示に従うためのファインチューニング

付録A PyTorch 入門

付録B 参考資料

付録C 練習問題の解答

付録D 訓練ループに高度なテクニックを追加する

付録E LoRAによるパラメータ効率のよいファインチューニング

“Build a Large Language Model (from Scratch)”(Manning Publishing 刊)の日本語版

※本データはこの商品が発売された時点の情報です。